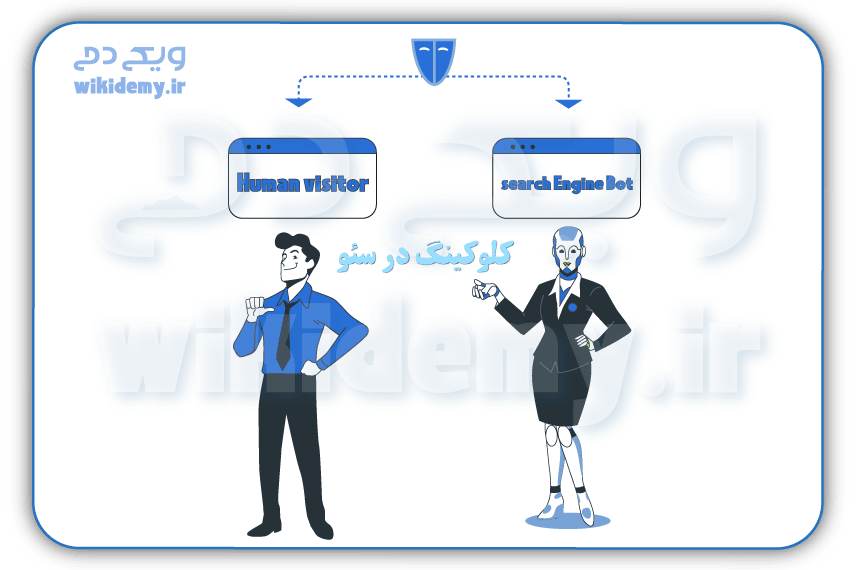

تا حالا سایتی دیدی که وقتی واردش میشی یک چیز ببینی، اما گوگل موقع خزش همون صفحه چیز دیگه ای رو بخونه؟ این دقیقا همون تکنیکی است که بهش Cloaking میگوییم. یعنی نشون دادن دو نسخه متفاوت از یک محتوا، یکی برای کاربر، یکی برای موتور جستجو. شاید در ظاهر ترفندی هوشمندانه و حتی خلاقانه به نظر برسه، اما برای گوگل مثل زنگ خطره: یعنی نشانه ای از فریب، دستکاری و بی اعتمادی.شاید قبلا میشد به این عمل گفت یک تکنیک، اما طی سال های گذشته و آپدیت های سنگین گوگل واقعا دیگه میشه گفت حتی اصلا تکنیک هم نیست و سریع گوگل متوجه میشه و میتواند خیلی خطرناک باشه.

در این مقاله یاد میگیری Cloaking دقیقا چیه، چرا باعث جریمه میشه، کدام الگوریتم های گوگل اون رو شناسایی میکنن و چطور میتوانی بدون نقض قوانین گوگل، محتوایی کاملا امن، طبیعی و بهینه تولید کنی. در پایان مقاله در بخش نتیجه گیری برای شما یک نکته طلایی آوردم که باعث میشود شما هیچوقت این کار را نکنید.

Cloaking چیست؟

Cloaking یعنی نمایش محتوایی متفاوت برای موتور جستجو و کاربر واقعی. هدف اصلی معمولا اینه که گوگل رو قانع کنن صفحه پر از محتوای ارزشمند و سئویی هست، در حالی که کاربر چیز کاملا بی ربط یا تبلیغاتی میبیند. به عبارت دیگه، گوگل رو گول میزنی تا فکر کنه سایتت مفید و تخصصیه، اما واقعیت چیز دیگه است.

در عمل، این یعنی ساخت یک ظاهر فریبنده برای الگوریتم ها، کاری که شاید در گذشته جواب میداد، اما امروز توسط سیستم های ضد اسپم گوگل مثل SpamBrain به راحتی شناسایی میشه.

انواع Cloaking

|

نوع کلواکینگ |

نحوه عملکرد |

مثال ساده |

ریسک و پیامد در سئو |

|

IP-based |

بر اساس IP کاربر یا ربات، نسخه های متفاوتی از محتوا نمایش میدهد. |

کاربر ایرانی نسخه فارسی میبیند، اما گوگل نسخه انگلیسی را میخواند. |

جریمه مستقیم توسط SpamBrain و حذف از ایندکس. |

|

User-Agent-based |

محتوا بر اساس شناسه مرورگر یا خزنده تغییر میکند. |

ربات گوگل محتوای پر از کلمه کلیدی میبیند. و کیورد استافینگ صورت میگیرد. |

حذف یا کاهش رتبه در نتایج جستجو. |

|

Referrer Cloaking |

محتوا بستگی به منبع ورودی کاربر دارد. |

کاربرانی که از گوگل می آیند، نسخه متفاوتی میبینند. |

فیلتر توسط SpamBrain + SafeSearch. |

|

JavaScript Cloaking |

محتوای واقعی بعد از اجرای جاوااسکریپت نمایش داده میشود. |

ربات گوگل چون JS اجرا نمیکند، نسخه ناقص میبیند. |

کاهش رتبه توسط الگوریتم رندر گوگل. |

|

CSS Cloaking |

پنهان کردن محتوا با رنگ یا استایل خاص. |

نوشتن متن سفید روی پس زمینه سفید. |

تشخیص سریع با Visual Spam Detection. |

|

AI-based Cloaking |

تغییر محتوای صفحه با تحلیل رفتار ربات ها توسط هوش مصنوعی. |

سیستم به صورت خودکار خزنده را شناسایی و نسخه ای جدید تولید میکند. |

حذف کامل دامنه از نتایج جستجو. |

|

Behavioral Cloaking |

محتوا بر اساس رفتار کاربر (مثل کلیک یا زمان ماندن) تغییر میکند. |

کاربر جدید تبلیغ میبیند، کاربر قدیمی محتوا. |

شناسایی ترکیبی توسط RankBrain و SpamBrain. |

همان طور که دیدی، هر نوع Cloaking روش خاصی برای پنهان کردن محتوا داره از تغییر بر اساس IP گرفته تا فریب خزنده با جاوااسکریپت یا CSS. اما برای درک واقعی این روش ها، باید ببینیم در عمل این ترفند ها چطور استفاده میشن و چرا گوگل سریع متوجهشان میشه.

مثال واقعی از انواع Cloaking

زبان / آی پی (IP-based)

- کاربر: وقتی از ایران وارد میشه، صفحه رو به صورت فارسی با تبلیغات محلی میبینه.

- گوگل: بر اساس IP ربات، نسخه انگلیسی پُر از کلمات کلیدی و متن سئویی نمایش داده میشه.

- چرا Cloaking: دو مخاطب (کاربر واقعی و خزنده) محتوای متفاوتی میبینن.

- ریسک: شناسایی و حذف صفحات یا جریمه دامنه.

- جلوگیری: برای زبان از hreflang و انتخاب زبان بر اساس تنظیمات مرورگر/کاربر استفاده کن، نه آی پی برای تولید محتوای متفاوت.

دقت کنید یه وقت هایی شما واقعا نمیخواید از این تکنیک سیاه استفاده کنید اما یکسری مشکلات در سایت و یکری عدم رعایت اصول سئو میتونه به گوگل این سیگنال رو بفرسته که داره کلوکینگ اتفاق میافته و گوگل به اشتباه شمارو جریمه کنه مخصوصا در سایت های چند زبانه.

شناسه مرورگر (User-Agent)

کاربر: نسخه معمولی صفحه با متن مفید و تصاویر محصول.

گوگل: وقتی User-Agent ربات تشخیص داده میشه، نسخه ای پر از متن تکراری و کلمات کلیدی هدف نمایش داده میشه.

چرا Cloaking: محتوا بر اساس User-Agent تغییر میکنه تا خزنده را فریب بده.

ریسک: کاهش رتبه یا حذف کامل از ایندکس.

جلوگیری: هیچ وقت محتوای متفاوت براساس User-Agent نمایش نده. اگر نیاز به نسخه ای سبک برای ربات داری، همون HTML رندرشده رو نمایش بده.

در حالت ساده یک وب سایت این مشکلات اصلا وجود ندارند. این زمانی رخ میده که صاحبان وب سایت و یا طراحان سایت توی این بخش ها تغییراتی اعمال میکنن. اگر یک سایت معمولی دارید اصلا نگران نباشید چون برای این تغییرات حتما نیاز به دانش برنامه نویسی هست.

جاوااسکریپت دینامیک (JavaScript Cloaking)

- کاربر: پس از اجرای JavaScript، صفحه محتوای کامل و قابل تعامل رو میبینه.

- گوگل: خزنده بدون اجرای برخی اسکریپت های خاص نسخه ای ناقص یا تبلیغاتی میبینه.

- چرا Cloaking: خروجی نهایی برای کاربر و خزنده فرق داره به خاطر اجرای/مسدود شدن JS.

- ریسک: کاهش رتبه به خاطر تفاوت رندر یا شناسایی با Render Engine.

- جلوگیری: مطمئن شو محتوا و عناصر اصلی بدون نیاز به JS هم در HTML وجود دارند یا از Server-Side Rendering استفاده کن.

یک راه ساده برای این موضوع اینه که خیلی از جاوا اسکریپت توی صفحات استفاده نکنی و همچنین حتی اگر استفاده هم کردی محتوای اصلی سایت اصلا در جاوا اسکریپت قرار نگیره.

پنهان سازی با استایل (CSS Cloaking / Hidden Text)

- کاربر: متن تبلیغاتی یا CTA را میبیند؛ متن دیگری (مثلا کلمه کلیدی) با رنگ پس زمینه هم رنگ متن پنهان شده.

- گوگل: برخی مکانیزم ها متن مخفی را میخوانند و فکر میکنند صفحه غنی از کلمات کلیدی است.

- چرا Cloaking: محتوای «قابل دیدن» و «متن پنهان» متفاوت اند.

- ریسک: تشخیص Visual Spam و پنالتی.

- جلوگیری: از پنهان سازی متن با CSS یا استایل خودداری کن، محتوای مهم باید برای همه قابل مشاهده باشه.

منبع ارجاع (Referrer Cloaking)

- کاربر: اگر از شبکه اجتماعی وارد شده باشه، صفحه تبلیغی میبینه؛ اگر از گوگل آمده باشه، نسخه ای پر از متن سئو میبینه.

- گوگل: خزنده ای که با ارجاع متفاوت شناسایی میشه، نسخه سئویی را میبیند.

- چرا Cloaking: محتوا بر اساس Referrer تغییر میکنه و دو تجربه متفاوت ساخته میشه.

- ریسک: فیلتر شدن توسط SpamBrain و کاهش اعتبار.

- جلوگیری: رفتار صفحه نسبت به منبع ترافیک باید فقط در نمایش عناصر کم اهمیت (مثل بنرهای پیشنهاد) تغییر کنه، نه متن اصلی.

یک نکته رو هم بدونید که خیلی وقتا ربات گوگل از طریق بک لینک های ما و یا شبکه های اجتماعی ما وارد سایت میشه و اینجا منظور اینه که اگر مستقیم وارد شد و یا اگر از طریق مثلا بک لینک وارد شد در هر شرایطی یک نسخه ببینه فقط.

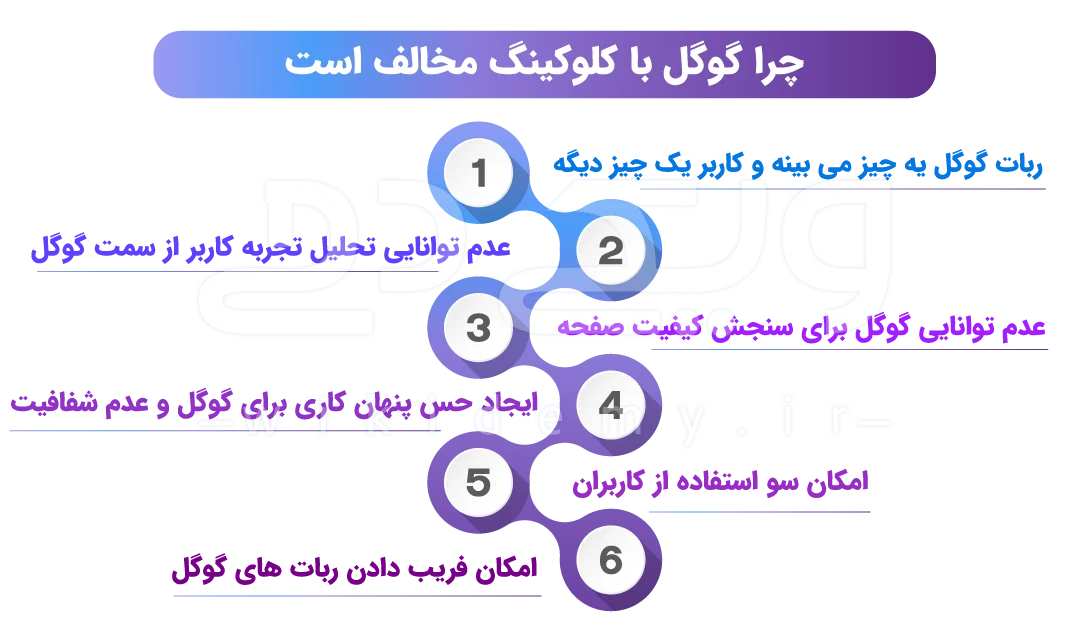

چرا گوگل با Cloaking مخالف است؟

گوگل در Search Quality Guidelines صراحتا اعلام کرده:

هر تفاوت عمدی بین چیزی که کاربر میبیند و چیزی که ربات گوگل میخونه، نقض سیاست های جستجو محسوب میشه. چون Cloaking باعث میشه گوگل نتونه تجربه واقعی کاربر رو درک کنه و در نتیجه اعتمادش به سایت از بین میره. در واقع، گوگل بر پایه شفافیت کار میکنه. وقتی دو نسخه متفاوت از محتوا وجود داره، گوگل احساس میکنه سایت در حال پنهان کاری است و در دنیای سئو، پنهان کاری مساوی با سقوط اعتماد و حذف از نتایج است.

Cloaking و ارتباط آن با EEAT و الگوریتم های گوگل

بیاید باهم از زاویه های مختلف این موضوع را بررسی کنیم:

1) E-E-A-T: این چهار شاخص اساس ارزیابی کیفیت محتوا در گوگل هستن. Cloaking بیشترین ضربه رو به بخش Trust یعنی اعتماد وارد میکنه، چون: کاربر یه چیز میبینه، گوگل چیز دیگه و شفافیت از بین میره، محتوا از نظر انسانی قابل اعتماد نیست.

نتیجه: سایتی که Cloaking داره، از دید گوگل فاقد اعتبار و صداقت محسوب میشه و امتیاز EEATش سقوط میکنه.

2) SpamBrain: این یکی موتور هوش مصنوعی گوگل برای شناسایی اسپمه (فعال از سال 2022). SpamBrain میتونه الگوهای رفتاری Cloaking رو تشخیص بده، حتی اگه با هوش مصنوعی یا جاوااسکریپت پنهان شده باشه. چطور؟ با مقایسه رفتار ربات، ساختار HTML، و نسخه کاربر.

نتیجه: SpamBrain عملا «دشمن طبیعی Cloaking» محسوب میشه. هر الگویی از تفاوت بین نسخه ها رو تشخیص میده و سایت رو جریمه میکنه.

3) Helpful Content Update: این آپدیت تمرکزش روی حذف محتواهاییه که برای ربات نوشته شدن نه برای انسان. Cloaking دقیقا این خط قرمز رو رد میکنه، چون: به گوگل یک نسخه «بهینه برای ربات» میده ولی به کاربر نسخه ای «فریبنده» یا بی ارزش

نتیجه: الگوریتم HCU مستقیما چنین صفحات رو De-index یا رتبه آن ها را نابود میکنه.

4) Fred Algorithm: فرد یکی از آپدیت های قدیمی ولی موثر گوگله (از ۲۰۱۷) که با سایت هایی که صرفا برای تبلیغات و کلیک ساخته شدن مبارزه میکنه. Cloaking معمولا در همین سایت ها استفاده میشه تا گوگل رو گول بزنن و ترافیک بگیرن.

نتیجه: گوگل Fred سایت هایی با Cloaking تبلیغاتی یا درآمدی رو Spam Site تلقی کرده و از نتایج حذف میکنه.

5) رنک برین و برد: این دو الگوریتم وظیفه درک معنای واقعی کلمات و نیت کاربر رو دارن. وقتی Cloaking وجود داره، محتوای دیده شده توسط گوگل با محتوای واقعی کاربر یکی نیست، در نتیجه: الگوریتم نمیتونه معنای درست محتوا رو بفهمه. سیگنال های رفتاری (مانند زمان ماندن در صفحه) دچار تناقض میشن.

نتیجه: امتیاز ارتباط معنایی (Relevance) کاهش پیدا میکنه و رتبه افت میکنه.

6) Search Quality Evaluator: گوگل از ارزیاب های انسانی برای سنجش کیفیت صفحات استفاده میکنه. در دستورالعمل رسمی اون ها (Search Quality Evaluator Guidelines) نوشته شده: «اگر صفحه ای برای کاربر و موتور جستجو محتوای متفاوتی نمایش دهد، این رفتار فریبنده و مغایر با کیفیت است.»

نتیجه: Cloaking نقض صریح قوانین ارزیابان انسانی گوگل محسوب میشه و در بازبینی انسانی، امتیاز منفی میگیره.

|

اثر Cloaking بر الگوریتم ها |

پیامد |

|

کاهش اعتماد و اعتبار (EEAT) |

افت Trust و حذف از نتایج |

|

شناسایی توسط SpamBrain |

پنالتی هوش مصنوعی |

|

تضاد با Helpful Content |

حذف خودکار محتوا |

|

فیلتر توسط Fred |

حذف سایت های تبلیغاتی |

|

اختلال در RankBrain و BERT |

کاهش درک معنایی محتوا |

|

نقض ارزیابی انسانی |

امتیاز منفی در کیفیت کلی |

در مجموع، Cloaking با تمام اصول EEAT در تضاده، چون اعتماد، شفافیت و تجربه کاربر را تخریب میکند.

ابزارهای تشخیص Cloaking

اگر شک داری سایتت یا رقبات از Cloaking استفاده میکنن، ابزارهای زیر دقیق ترین گزینه ها هستن:

|

ابزار |

کاربرد اصلی |

ویژگی خاص |

|

مقایسه نسخه ای که کاربر و گوگل میبینن. |

بهترین و مطمئن ترین ابزار بررسی تفاوت ها. |

|

|

Screaming Frog SEO Spider |

تحلیل کد HTML واقعی در مقابل متای صفحه. |

مناسب برای بررسی فنی کل سایت. |

|

SiteChecker Cloaking Test |

مشاهده نسخه های نمایش داده شده به کاربر و ربات. |

نمایش خروجی دقیق هر دو نسخه در یک URL. |

|

Ahrefs Site Audit |

گزارش احتمال Cloaking در صفحات. |

نمودارهای گرافیکی و تحلیل خودکار. |

|

DeepCrawl (Lumar) |

تحلیل رفتار خزنده های مختلف در مقیاس بزرگ. |

شناسایی الگوهای پنهان کاری. |

|

Fetch as Google (نسخه قدیمی GSC) |

نمایش محتوایی که گوگل دقیقا میبیند. |

بررسی بصری برای اطمینان نهایی. |

استفاده منظم از این ابزارها بهت کمک میکنه تا مطمئن بشی سایتت همیشه در مسیر شفاف و قابل اعتماد حرکت میکنه.

چگونه از Cloaking جلوگیری کنیم؟

گوگل خودش قانون طلایی سئو رو خیلی ساده گفته: «همان محتوایی را به کاربر و خزنده نشان بده که میخواهی ایندکس شود.» این یعنی هر چیزی که کاربر در صفحه میبیند، باید همان چیزی باشد که گوگل هم در هنگام خزش میخواند. Cloaking اغلب از اشتباهات ساده شروع میشود. مثلا پنهان کردن بعضی فایل ها، تغییر محتوا برای مناطق خاص، یا اضافه کردن تبلیغاتی که فقط برای کاربران نمایش داده میشود. در ادامه قدم به قدم یاد میگیری چطور جلویش را بگیری:

1) فایل های CSS و JS را در robots.txt مسدود نکن

بسیاری از وب سایت ها برای کاهش حجم خزش، به اشتباه فایل های استایل یا اسکریپت را از دسترسی گوگل خارج میکنند. اما نتیجه اش این است که گوگل صفحه را ناقص میبیند و ممکن است تصور کند محتوای واقعی پنهان شده است.

راه حل ساده است: اطمینان پیدا کن که مسیر فایل های /css/ و /js/ در robots.txt آزاد است تا گوگل بتواند صفحه را درست رندر کند.

اگه نگران سرعت سایتی سعی کن یا کم استفاده کنی از کد های اسکریپتی و یا خیلی بهینه استفاده کنی. حتی چند درصد سرعتت کمتر باشه خیلی بهتر از ریسک کلوکینگه

2) از ابزار “Inspect URL” در Search Console استفاده کن

این ابزار نشان میدهد گوگل دقیقا چه چیزی از صفحه ات میبیند. با گزینه ی “View Crawled Page” میتوانی تفاوت بین نسخه ی کاربر و نسخه ی خزیده را ببینی. اگر دو نسخه یکسان نیستند، باید بررسی کنی چه چیزی باعث تفاوت شده، مثلا اجرای ناقص جاوااسکریپت، یا مسدود بودن یک فایل CSS؛ این کار بهترین راه برای پیشگیری از خطاهای ناخواسته است.

3) برای محتوای چند زبانه یا منطقه ای از hreflang استفاده کن

اگر سایتت نسخه های مختلف برای زبان یا کشور دارد (مثلا فارسی برای ایران و عربی برای امارات)، هرگز با تغییر خودکار IP محتوای متفاوت نشان نده. در عوض، از تگ های استاندارد hreflang استفاده کن تا گوگل بفهمد هر نسخه مربوط به کدام زبان یا منطقه است. به این ترتیب هم تجربه کاربر حفظ میشود، هم خطری از نظر Cloaking نداری.

4) تبلیغات و لینک ها را فقط از دید کاربر پنهان نکن

بعضی مدیران سایت برای بهبود تجربه کاربر، تبلیغات یا لینک های خاصی را با CSS پنهان میکنند، اما برای گوگل همچنان در HTML باقی میمانند. گوگل این رفتار را «پنهان کاری عمدی» میداند. اگر تبلیغ یا لینک غیرضروری داری، یا باید آن را به درستی نوفالو (nofollow) کنی یا در جای مشخص و شفاف نمایش دهی.

5) از Structured Data واضح و معتبر استفاده کن

داده های ساختار یافته (مثل Review، FAQ، Product و …) باید دقیقا با محتوای واقعی صفحه هم خوان باشند. اگر مثلا در Structured Data امتیاز ۵ ستاره وارد کنی، ولی هیچ بخش امتیازدهی در صفحه وجود نداشته باشد، این خودش نوعی Cloaking است. گوگل از سال 2024 به بعد با چنین داده های جعلی به شدت برخورد میکند. پس همیشه مطمئن شو که داده ساختاریافته و محتوای قابل مشاهده یکی هستند.

Cloaking در سال 2025: نسخه مدرن اسپم

Cloaking دیگه مثل گذشته فقط «متن سفید روی پس زمینه سفید» نیست. امروز با استفاده از هوش مصنوعی، JavaScript و حتی یادگیری ماشینی انجام میشه تا رفتار ربات ها رو تقلید کنه. اما نکته مهم اینه که الگوریتم SpamBrain و سیستم های یادگیری گوگل حالا به قدری پیشرفته شدن که حتی الگو های پویا و تغییر پذیر رو هم تشخیص میدن. در نتیجه، هیچ تکنیکی در برابر شفافیت گوگل ماندگار نیست.

نباید فراموش کنی که

- Cloaking یعنی فریب دادن گوگل با دو نسخه متفاوت از محتوا، یکی برای کاربر، یکی برای ربات.

- هر نوع تفاوت عمدی بین محتوای کاربر و خزنده، نقض سیاست های گوگل است.

- SpamBrain و RankBrain Cloaking را حتی در نسخه های هوش مصنوعی شده شناسایی میکنند.

- E-E-A-T مستقیما با Cloaking در تضاد است؛ چون اعتماد (Trust) از بین میرود.

- Cloaking دیگر فقط «متن سفید روی پس زمینه سفید» نیست، حالا شامل جاوااسکریپت، IP، و رفتار کاربر هم میشود.

- در سال 2025، Cloaking یعنی نسخه مدرن اسپم، با ریسک حذف کامل دامنه از ایندکس.

- برای جلوگیری از Cloaking باید همان محتوایی را به گوگل و کاربر نشان دهی که میخواهی ایندکس شود.

- همیشه در Search Console نسخه ی رندرشده ی صفحه را بررسی کن تا مطمئن شوی تفاوتی وجود ندارد.

- فایل های CSS و JS را در robots.txt مسدود نکن تا گوگل بتواند محتوای واقعی را ببیند.

- اگر محتوای چندزبانه داری، از hreflang استفاده کن، نه Cloaking.

- هر نوع پنهان سازی تبلیغات یا لینک ها فقط از دید کاربر، یک سیگنال منفی برای گوگل است.

- Cloaking مستقیما با الگوریتم های Helpful Content، Fred و SpamBrain در تضاد است.

- ابزارهایی مثل GSC، Screaming Frog و Ahrefs بهترین راه برای تشخیص تفاوت نسخه ها هستند.

- صداقت در محتوا، پایدارترین استراتژی سئو است. Cloaking شاید کوتاه مدت جواب دهد، اما اعتماد را برای همیشه از بین میبرد.

- در دنیای امروز سئو، Cloaking یعنی بازی با اعتماد، و در این بازی همیشه بازنده تویی.

نکته طلایی

نتیجه گیری

Cloaking شاید در کوتاه مدت باعث افزایش بازدید یا رتبه بشه، اما در بلند مدت فقط یک نتیجه داره: از بین رفتن اعتماد گوگل و حذف از نتایج جستجو. گوگل امروز فقط به دنبال کلمات کلیدی نیست، بلکه به دنبال صداقت در محتوا، تجربه کاربر و شفافیت است.

اگر به دنبال رشد پایدار هستی، تنها مسیر واقعی، صداقت با کاربر و الگوریتم هاست.

Cloaking یعنی بازی با اعتماد، و در بازی با اعتماد، همیشه بازنده تویی.

درصورت داشتن سوال یا بودن ابهام در مقاله در کامنت ها برام بنویسید؛ خیلی سریع به سوالات شما پاسخ میدهیم “ارادتمند شما ویکی دمی”

دیدگاه شما